എന്താണ് ഒരു Robots.txt ഫയൽ? SEO-യ്ക്കായി നിങ്ങൾക്ക് ഒരു റോബോട്ടുകൾ എഴുതാനും സമർപ്പിക്കാനും വീണ്ടും ക്രോൾ ചെയ്യാനും ആവശ്യമായതെല്ലാം

ഞങ്ങൾ സമഗ്രമായ ഒരു ലേഖനം എഴുതിയിട്ടുണ്ട് സെർച്ച് എഞ്ചിനുകൾ നിങ്ങളുടെ വെബ്സൈറ്റുകൾ എങ്ങനെ കണ്ടെത്തുന്നു, ക്രാൾ ചെയ്യുന്നു, ഇൻഡെക്സ് ചെയ്യുന്നു. ആ പ്രക്രിയയിലെ അടിസ്ഥാനപരമായ ഒരു ഘട്ടമാണ് robots.txt ഫയൽ, നിങ്ങളുടെ സൈറ്റ് ക്രോൾ ചെയ്യുന്നതിനുള്ള ഒരു സെർച്ച് എഞ്ചിനുള്ള ഗേറ്റ്വേ. ഒരു robots.txt ഫയൽ എങ്ങനെ ശരിയായി നിർമ്മിക്കാമെന്ന് മനസ്സിലാക്കുന്നത് സെർച്ച് എഞ്ചിൻ ഒപ്റ്റിമൈസേഷനിൽ അത്യന്താപേക്ഷിതമാണ് (എസ്.ഇ.ഒ.).

ഈ ലളിതവും എന്നാൽ ശക്തവുമായ ഉപകരണം സെർച്ച് എഞ്ചിനുകൾ അവരുടെ വെബ്സൈറ്റുകളുമായി എങ്ങനെ ഇടപെടുന്നുവെന്ന് നിയന്ത്രിക്കാൻ വെബ്മാസ്റ്റർമാരെ സഹായിക്കുന്നു. ഒരു വെബ്സൈറ്റിന്റെ കാര്യക്ഷമമായ ഇൻഡക്സിംഗും സെർച്ച് എഞ്ചിൻ ഫലങ്ങളിൽ ഒപ്റ്റിമൽ ദൃശ്യപരതയും ഉറപ്പാക്കുന്നതിന് robots.txt ഫയൽ മനസ്സിലാക്കുകയും ഫലപ്രദമായി ഉപയോഗിക്കുകയും ചെയ്യേണ്ടത് അത്യാവശ്യമാണ്.

എന്താണ് ഒരു Robots.txt ഫയൽ?

ഒരു വെബ്സൈറ്റിന്റെ റൂട്ട് ഡയറക്ടറിയിൽ സ്ഥിതിചെയ്യുന്ന ഒരു ടെക്സ്റ്റ് ഫയലാണ് robots.txt ഫയൽ. സൈറ്റിന്റെ ഏതൊക്കെ ഭാഗങ്ങൾ ക്രോൾ ചെയ്യണമെന്നും സൂചികയിലാക്കണമെന്നും സെർച്ച് എഞ്ചിൻ ക്രാളർമാർക്ക് മാർഗ്ഗനിർദ്ദേശം നൽകുക എന്നതാണ് ഇതിന്റെ പ്രാഥമിക ലക്ഷ്യം. ഫയൽ റോബോട്ടുകൾ ഒഴിവാക്കൽ പ്രോട്ടോക്കോൾ ഉപയോഗിക്കുന്നു (REP), വെബ് ക്രാളറുമായും മറ്റ് വെബ് റോബോട്ടുകളുമായും ആശയവിനിമയം നടത്താൻ ഒരു സാധാരണ വെബ്സൈറ്റുകൾ ഉപയോഗിക്കുന്നു.

REP ഒരു ഔദ്യോഗിക ഇൻറർനെറ്റ് സ്റ്റാൻഡേർഡ് അല്ല, എന്നാൽ പ്രധാന സെർച്ച് എഞ്ചിനുകൾ വ്യാപകമായി അംഗീകരിക്കുകയും പിന്തുണയ്ക്കുകയും ചെയ്യുന്നു. ഗൂഗിൾ, ബിംഗ്, യാൻഡെക്സ് തുടങ്ങിയ പ്രമുഖ സെർച്ച് എഞ്ചിനുകളിൽ നിന്നുള്ള ഡോക്യുമെന്റേഷനാണ് അംഗീകൃത നിലവാരത്തോട് ഏറ്റവും അടുത്തത്. കൂടുതൽ വിവരങ്ങൾക്ക്, സന്ദർശിക്കുക Google-ന്റെ Robots.txt സ്പെസിഫിക്കേഷനുകൾ ശുപാർശ ചെയ്യുന്നു.

എന്തുകൊണ്ടാണ് Robots.txt SEO-യ്ക്ക് നിർണ്ണായകമായിരിക്കുന്നത്?

- നിയന്ത്രിത ക്രാളിംഗ്: Robots.txt വെബ്സൈറ്റ് ഉടമകളെ അവരുടെ സൈറ്റിന്റെ പ്രത്യേക വിഭാഗങ്ങൾ ആക്സസ് ചെയ്യുന്നതിൽ നിന്ന് സെർച്ച് എഞ്ചിനുകളെ തടയാൻ അനുവദിക്കുന്നു. ഡ്യൂപ്ലിക്കേറ്റ് ഉള്ളടക്കം, സ്വകാര്യ മേഖലകൾ അല്ലെങ്കിൽ സെൻസിറ്റീവ് വിവരങ്ങളുള്ള വിഭാഗങ്ങൾ എന്നിവ ഒഴിവാക്കുന്നതിന് ഇത് പ്രത്യേകിച്ചും ഉപയോഗപ്രദമാണ്.

- ഒപ്റ്റിമൈസ് ചെയ്ത ക്രോൾ ബജറ്റ്: സെർച്ച് എഞ്ചിനുകൾ ഓരോ വെബ്സൈറ്റിനും ഒരു ക്രാൾ ബജറ്റ് വകയിരുത്തുന്നു, ഒരു സെർച്ച് എഞ്ചിൻ ബോട്ട് ഒരു സൈറ്റിൽ ക്രാൾ ചെയ്യുന്ന പേജുകളുടെ എണ്ണം. അപ്രസക്തമോ പ്രാധാന്യമില്ലാത്തതോ ആയ വിഭാഗങ്ങൾ അനുവദിക്കാതിരിക്കുന്നതിലൂടെ, കൂടുതൽ പ്രധാനപ്പെട്ട പേജുകൾ ക്രോൾ ചെയ്യപ്പെടുകയും സൂചികയിലാക്കപ്പെടുകയും ചെയ്യുന്നുണ്ടെന്ന് ഉറപ്പാക്കിക്കൊണ്ട്, ഈ ക്രാൾ ബജറ്റ് ഒപ്റ്റിമൈസ് ചെയ്യാൻ robots.txt സഹായിക്കുന്നു.

- മെച്ചപ്പെടുത്തിയ വെബ്സൈറ്റ് ലോഡിംഗ് സമയം: അപ്രധാനമായ ഉറവിടങ്ങൾ ആക്സസ് ചെയ്യുന്നതിൽ നിന്ന് ബോട്ടുകളെ തടയുന്നതിലൂടെ, robots.txt-ന് സെർവർ ലോഡ് കുറയ്ക്കാനും സൈറ്റിന്റെ ലോഡിംഗ് സമയം മെച്ചപ്പെടുത്താനും കഴിയും, ഇത് SEO-യിലെ നിർണായക ഘടകമാണ്.

- പബ്ലിക്ക് അല്ലാത്ത പേജുകളുടെ ഇൻഡെക്സിംഗ് തടയുന്നു: പൊതുമേഖലകളല്ലാത്ത മേഖലകൾ (സ്റ്റേജിംഗ് സൈറ്റുകൾ അല്ലെങ്കിൽ വികസന മേഖലകൾ പോലുള്ളവ) സൂചികയിലാക്കുന്നതിൽ നിന്നും തിരയൽ ഫലങ്ങളിൽ ദൃശ്യമാകുന്നതിൽ നിന്നും ഇത് സഹായിക്കുന്നു.

Robots.txt അവശ്യ കമാൻഡുകളും അവയുടെ ഉപയോഗങ്ങളും

- അനുവദിക്കുക: സൈറ്റിന്റെ ഏതൊക്കെ പേജുകളോ വിഭാഗങ്ങളോ ക്രാളർമാർ ആക്സസ് ചെയ്യണമെന്ന് വ്യക്തമാക്കാൻ ഈ നിർദ്ദേശം ഉപയോഗിക്കുന്നു. ഉദാഹരണത്തിന്, ഒരു വെബ്സൈറ്റിന് SEO-യ്ക്ക് പ്രത്യേകമായി പ്രസക്തമായ ഒരു വിഭാഗം ഉണ്ടെങ്കിൽ, 'Allow' കമാൻഡിന് അത് ക്രാൾ ചെയ്യുന്നുവെന്ന് ഉറപ്പാക്കാൻ കഴിയും.

Allow: /public/- അനുവദിക്കരുത്: 'അനുവദിക്കുക' എന്നതിന് വിപരീതമായി, വെബ്സൈറ്റിന്റെ ചില ഭാഗങ്ങൾ ക്രോൾ ചെയ്യരുതെന്ന് സെർച്ച് എഞ്ചിൻ ബോട്ടുകൾക്ക് ഈ കമാൻഡ് നിർദ്ദേശിക്കുന്നു. ലോഗിൻ പേജുകൾ അല്ലെങ്കിൽ സ്ക്രിപ്റ്റ് ഫയലുകൾ പോലെയുള്ള SEO മൂല്യം ഇല്ലാത്ത പേജുകൾക്ക് ഇത് ഉപയോഗപ്രദമാണ്.

Disallow: /private/- വൈൽഡ് കാർഡുകൾ: പാറ്റേൺ പൊരുത്തപ്പെടുത്തലിനായി വൈൽഡ് കാർഡുകൾ ഉപയോഗിക്കുന്നു. നക്ഷത്രചിഹ്നം (*) പ്രതീകങ്ങളുടെ ഏത് ശ്രേണിയെയും പ്രതിനിധീകരിക്കുന്നു, ഡോളർ ചിഹ്നം ($) ഒരു URL-ന്റെ അവസാനത്തെ സൂചിപ്പിക്കുന്നു. വിപുലമായ ശ്രേണിയിലുള്ള URL-കൾ വ്യക്തമാക്കുന്നതിന് ഇവ ഉപയോഗപ്രദമാണ്.

Disallow: /*.pdf$- സൈറ്റ്മാപ്പുകൾ: robots.txt-ൽ ഒരു സൈറ്റ്മാപ്പ് ലൊക്കേഷൻ ഉൾപ്പെടുത്തുന്നത്, ഒരു സൈറ്റിലെ പ്രധാനപ്പെട്ട എല്ലാ പേജുകളും കണ്ടെത്താനും ക്രാൾ ചെയ്യാനും സെർച്ച് എഞ്ചിനുകളെ സഹായിക്കുന്നു. ഒരു സൈറ്റിന്റെ വേഗമേറിയതും പൂർണ്ണവുമായ സൂചികയിൽ ഇത് സഹായിക്കുന്നതിനാൽ SEO-യ്ക്ക് ഇത് നിർണായകമാണ്.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt അധിക കമാൻഡുകളും അവയുടെ ഉപയോഗങ്ങളും

- ഉപയോക്തൃ-ഏജൻറ്: ഏത് ക്രാളറിനാണ് നിയമം ബാധകമെന്ന് വ്യക്തമാക്കുക. 'ഉപയോക്തൃ ഏജന്റ്: *' എല്ലാ ക്രാളറുകൾക്കും നിയമം ബാധകമാണ്. ഉദാഹരണം:

User-agent: Googlebot- നോഇൻഡക്സ്: സ്റ്റാൻഡേർഡ് robots.txt പ്രോട്ടോക്കോളിന്റെ ഭാഗമല്ലെങ്കിലും, ചില തിരയൽ എഞ്ചിനുകൾ മനസ്സിലാക്കുന്നു a നോഇൻഡക്സ് നിർദ്ദിഷ്ട URL സൂചികയിലാക്കരുതെന്ന നിർദ്ദേശമായി robots.txt-ൽ നിർദ്ദേശം.

Noindex: /non-public-page/- ക്രാൾ-കാലതാമസം: സെർവർ ലോഡ് പ്രശ്നങ്ങളുള്ള സൈറ്റുകൾക്ക് ഉപയോഗപ്രദമായ, നിങ്ങളുടെ സെർവറിലേക്കുള്ള ഹിറ്റുകൾക്കിടയിൽ ഒരു നിശ്ചിത സമയം കാത്തിരിക്കാൻ ഈ കമാൻഡ് ക്രാളറുകളോട് ആവശ്യപ്പെടുന്നു.

Crawl-delay: 10നിങ്ങളുടെ Robots.txt ഫയൽ എങ്ങനെ പരിശോധിക്കാം

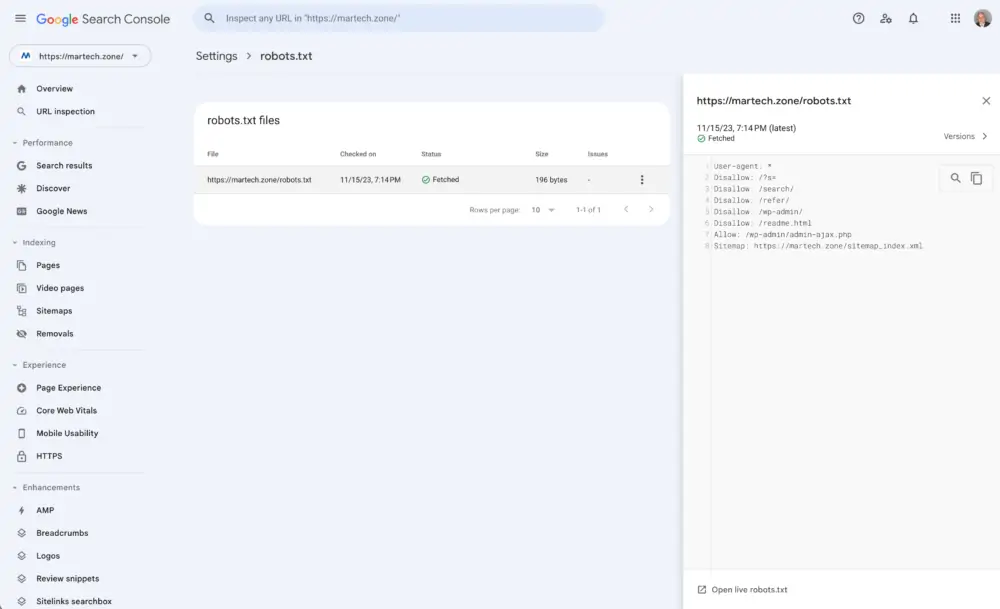

അത് കുഴിച്ചിട്ടിട്ടുണ്ടെങ്കിലും Google തിരയൽ കൺസോൾ, തിരയൽ കൺസോൾ ഒരു robots.txt ഫയൽ ടെസ്റ്റർ വാഗ്ദാനം ചെയ്യുന്നു.

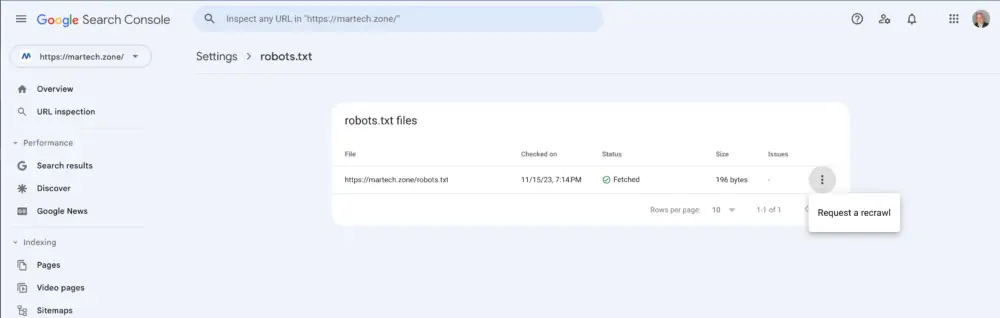

വലതുവശത്തുള്ള മൂന്ന് ഡോട്ടുകളിൽ ക്ലിക്കുചെയ്ത് തിരഞ്ഞെടുത്ത് നിങ്ങൾക്ക് Robots.txt ഫയൽ വീണ്ടും സമർപ്പിക്കാം ഒരു റീക്രോൾ അഭ്യർത്ഥിക്കുക.

നിങ്ങളുടെ Robots.txt ഫയൽ പരിശോധിക്കുക അല്ലെങ്കിൽ വീണ്ടും സമർപ്പിക്കുക

AI ബോട്ടുകൾ നിയന്ത്രിക്കാൻ Robots.txt ഫയൽ ഉപയോഗിക്കാമോ?

എന്ന് നിർവ്വചിക്കാൻ robots.txt ഫയൽ ഉപയോഗിക്കാം AI വെബ് ക്രാളറുകളും മറ്റ് ഓട്ടോമേറ്റഡ് ബോട്ടുകളും ഉൾപ്പെടെയുള്ള ബോട്ടുകൾക്ക് നിങ്ങളുടെ സൈറ്റിലെ ഉള്ളടക്കം ക്രാൾ ചെയ്യാനോ ഉപയോഗിക്കാനോ കഴിയും. വെബ്സൈറ്റിന്റെ ഏതൊക്കെ ഭാഗങ്ങളാണ് അവ ആക്സസ് ചെയ്യാൻ അനുവദിച്ചിരിക്കുന്നതെന്നോ അനുവദനീയമല്ലെന്നോ സൂചിപ്പിക്കുന്ന ഈ ബോട്ടുകളെ ഫയൽ നയിക്കുന്നു. AI ബോട്ടുകളുടെ സ്വഭാവം നിയന്ത്രിക്കുന്ന robots.txt-ന്റെ ഫലപ്രാപ്തി പല ഘടകങ്ങളെ ആശ്രയിച്ചിരിക്കുന്നു:

- പ്രോട്ടോക്കോൾ പാലിക്കൽ: ഏറ്റവും പ്രശസ്തമായ സെർച്ച് എഞ്ചിൻ ക്രാളറുകളും മറ്റ് നിരവധി AI ബോട്ടുകളും സജ്ജീകരിച്ചിരിക്കുന്ന നിയമങ്ങളെ മാനിക്കുന്നു

robots.txt. എന്നിരുന്നാലും, നടപ്പിലാക്കാവുന്ന നിയന്ത്രണത്തേക്കാൾ കൂടുതൽ അഭ്യർത്ഥനയാണ് ഫയൽ എന്നത് ശ്രദ്ധിക്കേണ്ടതാണ്. ബോട്ടുകൾക്ക് ഈ അഭ്യർത്ഥനകൾ അവഗണിക്കാൻ കഴിയും, പ്രത്യേകിച്ച് സൂക്ഷ്മത കുറഞ്ഞ എന്റിറ്റികൾ പ്രവർത്തിപ്പിക്കുന്നവ. - നിർദ്ദേശങ്ങളുടെ പ്രത്യേകത: വ്യത്യസ്ത ബോട്ടുകൾക്കായി നിങ്ങൾക്ക് വ്യത്യസ്ത നിർദ്ദേശങ്ങൾ വ്യക്തമാക്കാൻ കഴിയും. ഉദാഹരണത്തിന്, മറ്റുള്ളവരെ അനുവദിക്കാതിരിക്കുമ്പോൾ നിങ്ങളുടെ സൈറ്റ് ക്രോൾ ചെയ്യാൻ നിർദ്ദിഷ്ട AI ബോട്ടുകളെ നിങ്ങൾ അനുവദിച്ചേക്കാം. ഉപയോഗിച്ചാണ് ഇത് ചെയ്യുന്നത്

User-agentനിർദ്ദേശംrobots.txtമുകളിലുള്ള ഫയൽ ഉദാഹരണം. ഉദാഹരണത്തിന്,User-agent: GooglebotGoogle-ന്റെ crawler-നുള്ള നിർദ്ദേശങ്ങൾ വ്യക്തമാക്കുംUser-agent: *എല്ലാ ബോട്ടുകൾക്കും ബാധകമായിരിക്കും. - പരിമിതികളും: അതേസമയം

robots.txtനിർദ്ദിഷ്ട ഉള്ളടക്കം ക്രോൾ ചെയ്യുന്നതിൽ നിന്ന് ബോട്ടുകളെ തടയാൻ കഴിയും; അവർക്ക് ഇതിനകം അറിയാമെങ്കിൽ അത് അവരിൽ നിന്ന് ഉള്ളടക്കം മറയ്ക്കില്ല യുആർഎൽ. കൂടാതെ, ഉള്ളടക്കം ക്രോൾ ചെയ്തുകഴിഞ്ഞാൽ അതിന്റെ ഉപയോഗം നിയന്ത്രിക്കുന്നതിനുള്ള ഒരു മാർഗവും ഇത് നൽകുന്നില്ല. ഉള്ളടക്ക സംരക്ഷണമോ നിർദ്ദിഷ്ട ഉപയോഗ നിയന്ത്രണങ്ങളോ ആവശ്യമാണെങ്കിൽ, പാസ്വേഡ് പരിരക്ഷയോ കൂടുതൽ സങ്കീർണ്ണമായ ആക്സസ് നിയന്ത്രണ സംവിധാനങ്ങളോ പോലുള്ള മറ്റ് രീതികൾ ആവശ്യമായി വന്നേക്കാം. - ബോട്ടുകളുടെ തരങ്ങൾ: എല്ലാ AI ബോട്ടുകളും സെർച്ച് എഞ്ചിനുകളുമായി ബന്ധപ്പെട്ടതല്ല. വ്യത്യസ്ത ആവശ്യങ്ങൾക്കായി വിവിധ ബോട്ടുകൾ ഉപയോഗിക്കുന്നു (ഉദാ. ഡാറ്റ സമാഹരണം, അനലിറ്റിക്സ്, ഉള്ളടക്ക സ്ക്രാപ്പിംഗ്). ഈ വ്യത്യസ്ത തരത്തിലുള്ള ബോട്ടുകളുടെ ആക്സസ് മാനേജ് ചെയ്യാനും robots.txt ഫയൽ ഉപയോഗിക്കാനാകും, അവ REP പാലിക്കുന്നിടത്തോളം.

ദി robots.txt AI ബോട്ടുകൾ വഴി സൈറ്റ് ഉള്ളടക്കം ക്രാൾ ചെയ്യുന്നതും ഉപയോഗപ്പെടുത്തുന്നതും സംബന്ധിച്ച നിങ്ങളുടെ മുൻഗണനകൾ സൂചിപ്പിക്കുന്നതിനുള്ള ഫലപ്രദമായ ഉപകരണമാണ് ഫയൽ. എന്നിരുന്നാലും, കർശനമായ ആക്സസ്സ് നിയന്ത്രണം നടപ്പിലാക്കുന്നതിനുപകരം മാർഗ്ഗനിർദ്ദേശങ്ങൾ നൽകുന്നതിന് അതിന്റെ കഴിവുകൾ പരിമിതപ്പെടുത്തിയിരിക്കുന്നു, കൂടാതെ അതിന്റെ ഫലപ്രാപ്തി റോബോട്ട് എക്സ്ക്ലൂഷൻ പ്രോട്ടോക്കോളുമായി ബോട്ടുകൾ പാലിക്കുന്നതിനെ ആശ്രയിച്ചിരിക്കുന്നു.

robots.txt ഫയൽ SEO ആയുധപ്പുരയിലെ ചെറുതും എന്നാൽ ശക്തവുമായ ഒരു ഉപകരണമാണ്. ശരിയായി ഉപയോഗിക്കുമ്പോൾ വെബ്സൈറ്റിന്റെ ദൃശ്യപരതയെയും സെർച്ച് എഞ്ചിൻ പ്രകടനത്തെയും ഇതിന് കാര്യമായി സ്വാധീനിക്കാൻ കഴിയും. ഒരു സൈറ്റിന്റെ ഏതൊക്കെ ഭാഗങ്ങൾ ക്രോൾ ചെയ്യപ്പെടുകയും സൂചികയിലാക്കപ്പെടുകയും ചെയ്യുന്നു എന്നത് നിയന്ത്രിക്കുന്നതിലൂടെ, വെബ്മാസ്റ്റർമാർക്ക് അവരുടെ ഏറ്റവും മൂല്യവത്തായ ഉള്ളടക്കം ഹൈലൈറ്റ് ചെയ്തിട്ടുണ്ടെന്ന് ഉറപ്പാക്കാൻ കഴിയും, അവരുടെ SEO ശ്രമങ്ങളും വെബ്സൈറ്റ് പ്രകടനവും മെച്ചപ്പെടുത്തുന്നു.